LLM. Trois lettres qu’on croise partout — dans les médias, dans les réunions, dans les pitchs de startups — et pourtant, peu de gens peuvent en donner une vraie définition. Voici ce que signifie cet acronyme, comment ça fonctionne, et pourquoi ça change vraiment quelque chose à notre quotidien.

À retenir

- LLM = Large Language Model, soit “grand modèle de langage” en français.

- Un LLM ne comprend pas le langage : il prédit le mot suivant en calculant des probabilités statistiques.

- Son fonctionnement repose sur trois phases : entraînement massif, reconnaissance de schémas, prédiction contextuelle.

- Les hallucinations ont drastiquement reculé sur les tâches simples (de 21,8% en 2021 à moins de 1% en 2025), mais restent élevées sur les documents longs — dépassant 10% pour tous les modèles de raisonnement testés.

- Open source vs propriétaire : l’écart de performance se réduit à 5 points, mais l’écart de coût reste massif — jusqu’à 85% moins cher côté open source.

- La course mondiale s’accélère, avec des modèles frontier qui se renouvellent tous les deux à trois mois.

LLM : la signification de l’acronyme

LLM signifie Large Language Model — ou “grand modèle de langage” en français. Concrètement, c’est un système d’intelligence artificielle entraîné sur des volumes astronomiques de textes — des milliards de pages issues de Wikipedia, de livres, d’articles scientifiques, de forums — pour apprendre la structure statistique du langage humain.

Ce que fait un LLM ensuite, c’est déceptivement simple : il prédit le mot suivant. Pas de conscience, pas de raisonnement au sens humain du terme. Du calcul de probabilités, sophistiqué à l’extrême. Quand vous tapez une question dans ChatGPT, vous interagissez avec un LLM — un modèle qui ne “sait” pas que Paris est la capitale de la France, mais qui a appris que ces deux mots apparaissent systématiquement ensemble dans des milliers de textes.

Une petite précision orthographique qui échappe à beaucoup : en français, un acronyme en majuscules ne prend pas de “s” au pluriel. On écrit donc “des LLM”, pas “des LLMs” — même si les deux formes circulent librement sur le web.

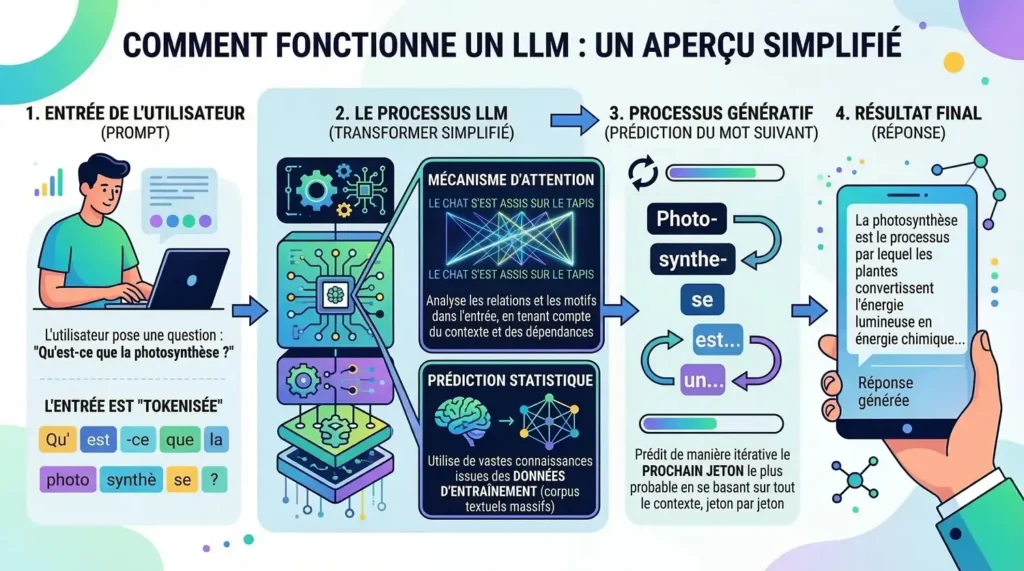

Comment fonctionne un LLM, vraiment ?

Tout commence par l’architecture Transformer, introduite en 2017 dans un article devenu culte intitulé “Attention Is All You Need”. C’est cette architecture qui permet aux LLM de traiter des séquences de texte entières — et non mot par mot — en pondérant dynamiquement l’importance de chaque terme selon son contexte. Résultat : le modèle capte des relations linguistiques à très longue distance dans un texte, là où les architectures précédentes se perdaient.

Le processus d’entraînement se déroule en deux temps. D’abord, le pré-entraînement sur des données massives, qui permet au modèle de développer une compréhension statistique générale du langage. Ensuite, le fine-tuning — un affinage sur des tâches précises, souvent guidé par des évaluateurs humains via une technique appelée RLHF (Reinforcement Learning from Human Feedback). C’est cette deuxième phase qui transforme un moteur de prédiction brut en assistant conversationnel utilisable.

En 2026, deux évolutions architecturales dominent le paysage. Les modèles dits reasoning — comme o3 d’OpenAI ou DeepSeek-R1 — décomposent les problèmes en étapes intermédiaires avant de répondre, améliorant les performances sur les tâches complexes. Et l’architecture Mixture of Experts (MoE) s’impose comme nouveau standard d’efficacité : Llama 4 Maverick affiche 400 milliards de paramètres totaux, mais n’en active que 17 milliards par requête — réduisant drastiquement le coût d’inférence sans sacrifier la qualité.

Ce saut architectural n’est pas qu’un détail technique — c’est ce qui rend possible l’exécution de LLM puissants sur des infrastructures bien moins coûteuses qu’il y a deux ans.

Le problème des hallucinations — état des lieux 2026

C’est le sujet qui fâche, et pourtant il faut en parler honnêtement — avec les nuances que la situation exige désormais.

La bonne nouvelle d’abord. Sur les tâches simples de résumé de texte, les progrès sont spectaculaires : on est passé de 21,8% d’hallucination en 2021 à moins de 1% en 2025. Gemini 2.0 Flash mène à 0,7%, GPT-4.1 suit à 2%. C’est une réduction de 96% en quatre ans.

La mauvaise nouvelle ensuite. Sur les documents longs, le tableau est différent. Sur le benchmark Vectara (7 700 documents longs), tous les modèles de raisonnement testés dépassent 10% d’hallucination — Grok-4 Fast Reasoning atteignant même 20,2%. L’explication est mécanique : quand un modèle “réfléchit plus longtemps”, il ne se contente pas d’extraire des faits, il tire des inférences — et chaque ajout qui dépasse le texte source est une opportunité de déraper.

Exception notable : Claude Opus 4.6 affiche 91% de détection des fausses prémisses sur BullshitBench v2 (mars 2026) — seul modèle au-dessus de 90%.

La raison structurelle persiste : les systèmes d’évaluation récompensent les bonnes réponses, mais ne pénalisent pas vraiment l’aveu d’ignorance. Le modèle a statistiquement intérêt à bluffer plutôt qu’à dire “je ne sais pas” — exactement comme un étudiant qui coche au hasard plutôt que de laisser la case vide.

Lors de la rédaction de cet article, j’ai demandé à un LLM populaire de me citer trois études récentes sur les biais dans les modèles de langage. Il m’en a proposé quatre, avec auteurs, revues et années de publication. Deux d’entre elles n’existaient pas. Les détails étaient parfaitement plausibles — c’est précisément ce qui rend le phénomène dangereux.

La question n’est donc pas “peut-on faire confiance à un LLM ?” mais “sur quelles tâches, avec quelles précautions ?”

Comparatif des grands modèles LLM en 2026

L’open source a rattrapé le propriétaire à une vitesse que peu d’experts anticipaient. En janvier 2026, l’écart de qualité entre les meilleurs modèles open source et propriétaires n’est plus que de 5 points — pour des coûts souvent 5 à 10 fois inférieurs.

| Modèle | Éditeur | Type | Cas d’usage idéal | Coût API (entrée/sortie, par M tokens) | Point fort |

|---|---|---|---|---|---|

| Gemini 3.1 Pro | Propriétaire | Multimodal, documents longs | ~4,50 $ / M | 94,3% GPQA — meilleur score raisonnement | |

| Claude Opus 4.6 | Anthropic | Propriétaire | Raisonnement complexe, code | ~30 $ / M | 91% détection fausses prémisses |

| GPT-5.2 | OpenAI | Propriétaire | Automatisation pro, polyvalence | ~5 $ / M | Meilleure intégration écosystème |

| Mistral Large 3 | Mistral (🇫🇷) | Open source (Apache 2.0) | Souveraineté européenne, RGPD | 2 $ / 6 $ | Champion open source européen, hébergeable |

| Llama 4 Maverick | Meta | Open-weight | Multimodal, budget maîtrisé | ~0,50 $ / 0,77 $ | Architecture MoE, 400B params, open-weight |

| DeepSeek V3.2 | DeepSeek | Open source | Coût ultra-bas, code | 0,30 $ / M | 85% moins cher que GPT-5.1 pour 4 points d’écart |

Comment choisir ? Pour la souveraineté des données et le respect du RGPD, Mistral Large 3 reste la référence européenne. Pour les volumes importants où le coût prime, DeepSeek V3.2 ou Llama 4 Maverick offrent le meilleur rapport qualité/prix. Pour les tâches critiques nécessitant une fiabilité maximale, Claude Opus 4.6 se distingue sur la détection des erreurs.

Propriétaire ou open source : le choix qui compte vraiment

La frontière s’est considérablement réduite. En mars 2026, les meilleurs modèles open source atteignent 89 à 94% des performances des modèles propriétaires — pour un coût d’inférence divisé par 5 à 10, voire par 25 en auto-hébergement à grande échelle.

Mistral, la pépite française fondée en 2023, publie ses modèles sous licence Apache 2.0 : utilisables commercialement, hébergeables localement, sans restriction. À 0,40 $ d’entrée et 2,00 $ de sortie par million de tokens pour Mistral Medium 3, l’économie est réelle — jusqu’à 60-80% par rapport aux solutions premium propriétaires. Pour une entreprise traitant plus de 50 millions de tokens par mois, la différence devient stratégique.

Les modèles open source en moyenne coûtent 0,83 $ par million de tokens contre 6,03 $ pour les propriétaires — soit une réduction de 86%. Ce n’est plus une question de budget serré, c’est une décision d’architecture.

Ce que l’acronyme LLM cache vraiment

Derrière trois lettres se joue une transformation profonde de notre rapport à l’information et au langage. Les LLM ne “pensent” pas — mais ils prédisent avec une précision qui ressemble de plus en plus à de la compréhension. Cette nuance est essentielle : elle conditionne à la fois l’utilité de ces outils et leurs limites.

Utiliser un LLM de façon éclairée, c’est comprendre ce qu’il est : une machine probabiliste extraordinairement sophistiquée, pas un oracle. C’est tirer profit de sa capacité à synthétiser, reformuler, générer — tout en gardant l’œil critique ouvert sur ce qu’il produit. La technologie est là, elle est puissante, et elle continuera d’évoluer vite. Ce qui ne changera pas, c’est le besoin d’un utilisateur qui sait quand lui faire confiance — et quand vérifier.

FAQ — Les questions les plus posées sur les LLM

Que signifie l’acronyme LLM ?

LLM signifie Large Language Model, soit “grand modèle de langage” en français. C’est un système d’intelligence artificielle entraîné sur des milliards de textes pour prédire le mot suivant avec la probabilité la plus élevée selon le contexte. ChatGPT, Gemini, Claude ou Mistral sont tous des LLM.

Quelle est la différence entre un LLM open source et propriétaire ?

Un LLM propriétaire (ChatGPT, Gemini, Claude) est contrôlé par une entreprise privée : vos données transitent par ses serveurs et peuvent potentiellement être utilisées pour améliorer leurs modèles. Un LLM open source (Mistral, Llama, DeepSeek) peut être hébergé localement sur votre propre infrastructure, offrant une maîtrise totale des données et des coûts réduits de 60 à 86% selon les volumes traités. Pour les entreprises soumises au RGPD, ce choix n’est pas anodin.

Qu’est-ce qu’une hallucination dans un LLM ?

Une hallucination, c’est quand un LLM invente une information — une citation inexistante, un chiffre erroné, un événement fictif — en la présentant avec une totale confiance. Ce phénomène est structurel : les modèles sont entraînés à produire des séquences cohérentes, pas nécessairement vraies. En 2026, les progrès sont réels sur les textes courts (moins de 1% d’erreur sur le résumé simple), mais tous les modèles de raisonnement dépassent encore 10% d’hallucination sur les documents longs.

Quel LLM choisir en 2026 ?

Tout dépend de votre usage :

- Raisonnement complexe et fiabilité → Claude Opus 4.6 (91% de détection des fausses prémisses) ou Gemini 3.1 Pro (94,3% au benchmark GPQA)

- Code et développement → Claude Opus 4.6 ou GPT-5.2

- Souveraineté des données, conformité RGPD → Mistral Large 3 (open source, Apache 2.0, hébergeable en France)

- Budget maîtrisé à grande échelle → DeepSeek V3.2 à 0,30 $ le million de tokens — 85% moins cher que GPT-5.1 pour seulement 4 points d’écart de performance

- Multimodal et polyvalence → Llama 4 Maverick (open-weight, architecture MoE, natif image + texte)

Il n’existe pas de meilleur LLM universel — il existe le meilleur LLM pour votre contexte.

En résumé

Les LLM ne sont pas des intelligences qui pensent. Ce sont des machines probabilistes d’une sophistication remarquable, capables de transformer la façon dont vous travaillez, rédigez, cherchez et automatisez — à condition de comprendre ce qu’elles sont et ce qu’elles ne sont pas.

En 2026, le paysage a radicalement changé : l’open source talonne le propriétaire à 5 points de performance, pour un coût parfois dix fois inférieur. Les hallucinations reculent sur les tâches simples, mais persistent sur les contenus complexes. Et la compétition mondiale — OpenAI, Google, Anthropic, Meta, Mistral, DeepSeek — produit de nouveaux modèles frontier tous les deux à trois mois.

Ce qui ne change pas, c’est le rôle de l’utilisateur : comprendre l’outil, calibrer la confiance qu’on lui accorde, et toujours vérifier ce qui compte vraiment.